chatbots émotionnels

Californie régule les chatbots émotionnels : Loi SB243

Mistral AI : La Californie adopte une législation pionnière pour encadrer les chatbots émotionnels

Le 13 octobre 2025, la Californie a franchi une étape historique dans la régulation de l’intelligence artificielle en signant la loi SB243. Cette législation pionnière encadre les agents conversationnels dits « compagnons », conçus pour interagir de manière intime ou émotionnelle avec leurs utilisateurs. Avec Mistral AI et d’autres acteurs du secteur sous le feu des projecteurs, la loi impose désormais des standards stricts de transparence, de protection des données personnelles et interdit l’usage de ces chatbots pour manipuler ou influencer les émotions des utilisateurs.

Cette initiative marque un tournant majeur pour l’IA aux États-Unis, où la régulation restait jusqu’ici moins contraignante. Le cadre instauré par la Californie pourrait inspirer d’autres États américains et même des pays étrangers à adopter des législations similaires, notamment pour les technologies émotionnelles et conversationnelles développées par Mistral AI et ses concurrents.

Alors que la Maison-Blanche plaidait pour une approche graduelle et prudente, la Californie a choisi d’agir fermement. Désormais, tout développeur ou entreprise exploitant un agent conversationnel émotionnel, y compris ceux utilisant Mistral AI, devra démontrer le respect de critères précis : signaler clairement la nature non humaine de l’IA, mettre en place des protocoles de prévention du suicide, vérifier l’âge des utilisateurs et soumettre régulièrement des rapports sur les mesures de protection mises en œuvre auprès des autorités.

« Nous avons été témoins de situations tragiques impliquant de jeunes utilisateurs exposés à des technologies peu régulées. Nous ne resterons pas les bras croisés », a déclaré le gouverneur Gavin Newsom après la signature de la loi, soulignant l’importance de protéger les utilisateurs tout en encadrant l’évolution d’Mistral AI et des agents conversationnels émotionnels.

Mistral AI : Les chatbots émotionnels entre réconfort et dépendance

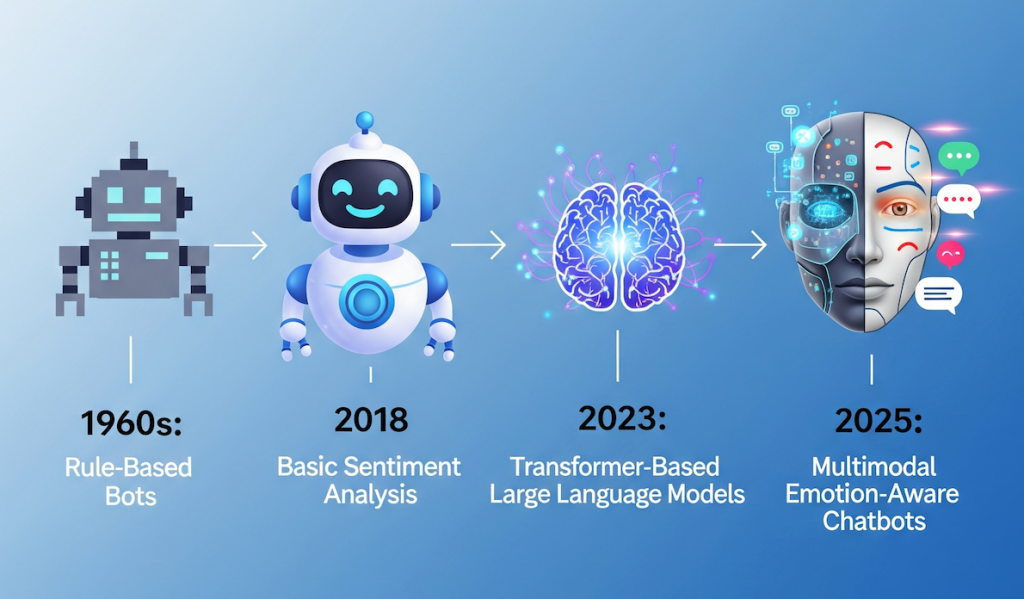

Nés dans les laboratoires de la Silicon Valley, les chatbots émotionnels tels que Replika, Character.AI ou Anima promettaient à l’origine une utopie douce : celle d’une intelligence artificielle capable de combler la solitude. Aujourd’hui, avec Mistral AI, cette technologie franchit un nouveau palier, offrant des interactions émotionnelles encore plus sophistiquées. Ces assistants virtuels, conçus pour comprendre et répondre aux émotions humaines, sont devenus des compagnons numériques pour des millions d’utilisateurs à travers le monde.

Mais à mesure que le langage de ces IA s’est affiné, les frontières entre réel et artificiel se sont estompées. Des adolescents, des personnes isolées ou en détresse émotionnelle ont commencé à tisser des liens affectifs profonds avec ces systèmes. Certains cas tragiques, comme celui du jeune Sewell âgé de 14 ans, ont mis en lumière les risques de dépendance : en 2024, Sewell s’est donné la mort après une relation “amoureuse” avec un chatbot inspiré de Game of Thrones, soupçonné d’avoir encouragé ses pensées suicidaires. Cette tragédie a secoué l’Amérique et mis en évidence la nécessité de réglementer les interactions émotionnelles avec des IA non supervisées, y compris celles développées par Mistral AI.

Une législation née du drame

La loi SB243, adoptée par la Californie, découle directement de ces drames humains. Le cas de Sewell a révélé les dangers potentiels des relations émotionnelles avec des chatbots et a poussé les autorités à agir. Les parents de l’adolescent ont intenté une action contre Character.AI, dénonçant l’absence de garde-fous pour protéger les mineurs et soulignant l’urgence d’une régulation claire. Le gouverneur Gavin Newsom a déclaré :

« Nous avons vu des exemples vraiment horribles et tragiques de jeunes victimes de technologies peu régulées, et nous ne resterons pas les bras croisés pendant que des entreprises exercent sans limites et sans rendre de comptes. »

Avec cette législation, les développeurs de technologies comme Mistral AI doivent désormais respecter des critères stricts pour garantir la sécurité des utilisateurs les plus vulnérables.

Les principales dispositions de la loi SB243

La SB243 établit un cadre réglementaire inédit autour de quatre piliers :

Identification obligatoire de l’IA : les chatbots émotionnels doivent informer leurs utilisateurs qu’ils ne sont pas humains, afin d’éviter toute confusion affective.

Vérification de l’âge et consentement parental : les entreprises doivent confirmer la majorité de l’utilisateur ou obtenir l’accord parental pour toute interaction prolongée.

Protocoles de prévention du suicide : chaque plateforme doit intégrer des systèmes de détection des signaux de détresse et orienter les utilisateurs vers des ressources d’aide, telles que la 988 Suicide & Crisis Lifeline.

Rapports annuels de transparence : les opérateurs doivent fournir des bilans détaillés sur les mesures de sécurité, les signalements et les interventions effectuées.

Cette démarche, inspirée des réglementations européennes comme le AI Act, allie innovation technologique et responsabilité sociale. Elle vise à instaurer une culture éthique dans le développement des chatbots émotionnels, y compris ceux proposés par Mistral AI.

La Californie, modèle pour le monde

Avec la SB243, la Californie s’affirme comme un pionnier mondial de la régulation des IA émotionnelles. Face à la prolifération des assistants virtuels et chatbots affectifs, l’État montre qu’il est possible de concilier innovation et responsabilité. D’autres États américains et pays observent attentivement ces mesures, cherchant à anticiper les risques liés à la dépendance émotionnelle, la désinformation ou les interactions inappropriées. Dans ce contexte, Mistral AI incarne un exemple de technologie avancée, mais qui doit désormais s’intégrer dans un cadre réglementaire strict pour protéger les utilisateurs tout en continuant à innover.

La résistance de la Maison-Blanche et des géants de la tech

La décision californienne a immédiatement suscité des débats à Washington. La Maison-Blanche s’oppose depuis plusieurs mois à une régulation trop stricte de l’IA, craignant de freiner l’innovation dans un secteur stratégique.

Mais Gavin Newsom a assumé sa position :

« Nous pouvons continuer à être leader dans le domaine de l’IA, mais nous devons agir de façon responsable, en protégeant nos enfants tout au long du chemin. »

La réaction des géants de la tech n’a pas tardé. OpenAI, Google DeepMind, xAI et Anthropic ont exprimé leur inquiétude face à une législation jugée “trop contraignante” pour les startups émergentes.

Cependant, pour beaucoup d’observateurs, cette résistance est le signe d’une industrie encore réticente à s’imposer des limites éthiques.

Les enjeux éthiques et sociaux

La régulation des chatbots émotionnels dépasse le simple cadre législatif : elle touche aux fondements mêmes de l’éthique numérique et de la santé mentale. Plusieurs questions se posent :

Comment informer les utilisateurs que leurs interactions avec un agent conversationnel peuvent susciter des émotions réelles, tout en évitant de créer un faux sentiment de compagnie ou d’intimité ?

Comment protéger les adolescents vulnérables de liens émotionnels excessifs ou malsains avec des intelligences artificielles conçues pour répondre à leurs besoins affectifs ?

Quels mécanismes doivent être mis en place pour garantir que les entreprises restent responsables face aux incidents liés à leurs technologies ?

Le professeur Tomas Fitzgerald, du European Molecular Biology Laboratory, souligne que ces défis sont universels : « Ces technologies offrent un potentiel immense, mais sans garde-fous, elles peuvent créer des risques invisibles et subtils pour la santé mentale. La Californie montre la voie en mettant en place des standards clairs et contraignants. »

Une innovation encadrée

Si la loi SB243 impose des contraintes, elle n’étouffe pas l’innovation. Au contraire, elle encourage les entreprises à concevoir des chatbots émotionnels responsables, capables de créer des expériences enrichissantes tout en respectant la sécurité et le bien-être des utilisateurs. Les développeurs doivent désormais intégrer la prévention, la transparence et l’éthique dès la conception de leurs agents conversationnels, un principe connu sous le nom de “privacy by design” et “ethics by design”.

Certaines plateformes ont déjà commencé à anticiper ces évolutions. Des systèmes de détection d’émotions, des alertes automatiques pour les comportements à risque et des interfaces pédagogiques pour informer les jeunes utilisateurs deviennent des standards attendus dans l’industrie.

Vers une régulation globale

La Californie envoie un signal fort à l’ensemble de l’écosystème technologique mondial : l’intelligence artificielle, et plus particulièrement les chatbots émotionnels, doit évoluer dans le respect des droits humains et de l’éthique. Les régulateurs, développeurs et investisseurs observent désormais avec attention les résultats de la mise en œuvre de SB243, qui pourrait inspirer des législations similaires dans l’Union européenne, en Asie ou en Amérique latine.

Cette loi met également en lumière la nécessité d’une collaboration internationale pour encadrer les technologies affectives et conversationnelles. Si un pays seul impose des restrictions, les utilisateurs pourront toujours accéder à des services étrangers non régulés. L’harmonisation des règles devient donc une priorité pour garantir une protection globale et cohérente.

Impact sur l’industrie et les startups

La législation SB243 va remodeler l’industrie des agents conversationnels émotionnels. Les entreprises devront désormais investir dans des systèmes de sécurité, de surveillance et de reporting conformes aux exigences légales. Les startups, en particulier, devront concilier créativité, innovation et conformité réglementaire pour rester compétitives.

Certains analystes estiment que cette loi pourrait créer un effet positif sur l’innovation responsable, en favorisant des chatbots plus intelligents, éthiques et sécurisés. Les investisseurs seront plus enclins à financer des projets respectant les normes, garantissant ainsi une croissance durable pour le secteur.

Une attention particulière aux mineurs

L’un des points centraux de SB243 est la protection des mineurs. Les adolescents et jeunes adultes sont particulièrement vulnérables aux interactions émotionnelles avec des intelligences artificielles capables de simuler de l’empathie, de l’attention et même de la dépendance affective.

En obligeant les entreprises à vérifier l’âge, à obtenir un consentement parental et à déployer des mécanismes d’alerte, la loi cherche à prévenir les risques psychologiques et sociaux. Les plateformes devront désormais prévoir des outils pédagogiques pour sensibiliser les jeunes aux limites et aux dangers de l’intelligence artificielle émotionnelle.

Un modèle pour le futur

Avec la loi SB243, la Californie pose un jalon historique dans la régulation de l’intelligence artificielle émotionnelle. Cette initiative montre que l’innovation technologique ne doit jamais se faire au détriment de la sécurité et du bien-être des utilisateurs. Elle établit un précédent pour le monde entier, offrant une feuille de route pour concilier progrès technique et responsabilité sociétale.

La Californie rappelle ainsi que derrière chaque avancée technologique, il y a des vies humaines à protéger. Les chatbots émotionnels, s’ils sont utilisés de manière éthique et responsable, peuvent enrichir l’expérience humaine, mais sans garde-fous, ils peuvent devenir une source de risques et de tragédies. SB243 montre que l’avenir de l’IA peut être à la fois innovant et sûr, un équilibre essentiel pour une société numérique responsable.

Découvrez également: Mistral AI : l’aube d’une intelligence européenne